La ricerca autonoma delle macchine traghetterà verso un progresso sostenibile o avrà effetti imprevedibili e dannosi? Esperti e super forecasters si dividono sul futuro dell’AI

Cosa succederebbe se l’Intelligenza Artificiale diventasse così abile da poter accelerare ricerca e sviluppo su sé stessa? Questa è la domanda che anima uno dei dibattiti più cruciali del momento, evocando sia scenari di miglioramento ricorsivo culminabili in una “esplosione di intelligenza” con impatti sociali profondi, sia ipotesi con effetti imprevedibili e dannosi. Sebbene l’idea di un’IA che si auto-migliora sia diventata una preoccupazione concreta per regolatori e sviluppatori, fino ad oggi poche ricerche hanno tentato di quantificare sistematicamente le probabilità e le conseguenze di un tale evento. Un recente studio pilota, dal titolo Forecasting the Significance of AI R&D Capabilities: Results of a Pilot Study, a cura dell’istituto di ricerca no-profit METR, si è addentrato in questo argomento inesplorato utilizzando una metodologia nota come judgmental forecasting.

La ricerca ha messo a confronto le previsioni di due gruppi distinti: da un lato, esperti con esperienza specifica nel campo dell’IA, e dall’altro super forecasters. Questi ultimi sono individui, persone reali, con una comprovata e straordinaria capacità di prevedere eventi futuri. Sono persone che hanno un elevato pensiero probabilistico, per cui se sottoposte a determinate prove possono mostrare statisticamente degli ottimi risultati nella predizione di eventi accurati. L’obiettivo dello studio è duplice: capire se un’IA capace di fare ricerca su sé stessa possa portare a un’accelerazione esponenziale del progresso tecnologico e se, in tal caso, questo progresso possa scatenare eventi estremi, come crisi energetiche globali o altre catastrofi su larga scala.

Una difficile previsione

I risultati di questo esperimento hanno rivelato una sorprendente dicotomia. Da un lato, esperti e super forecasters concordano ampiamente sulla prima questione. Ovvero, che la ricerca dell’AI su sé stessa aumenterà esponenzialmente ed altrettanto velocemente sarà in grado di fornire risposte utili in ambito tecnologico. Infatti, entrambi i gruppi ritengono che ci sia una probabilità non trascurabile (mediana del 20% per gli esperti e 8% per i super forecasters) che il ritmo del progresso dell’IA possa almeno triplicare entro il 2029. Ancor più significativo, concordano sul fatto che il raggiungimento di capacità di R&S autonome da parte dell’IA aumenterebbe drasticamente tale probabilità.

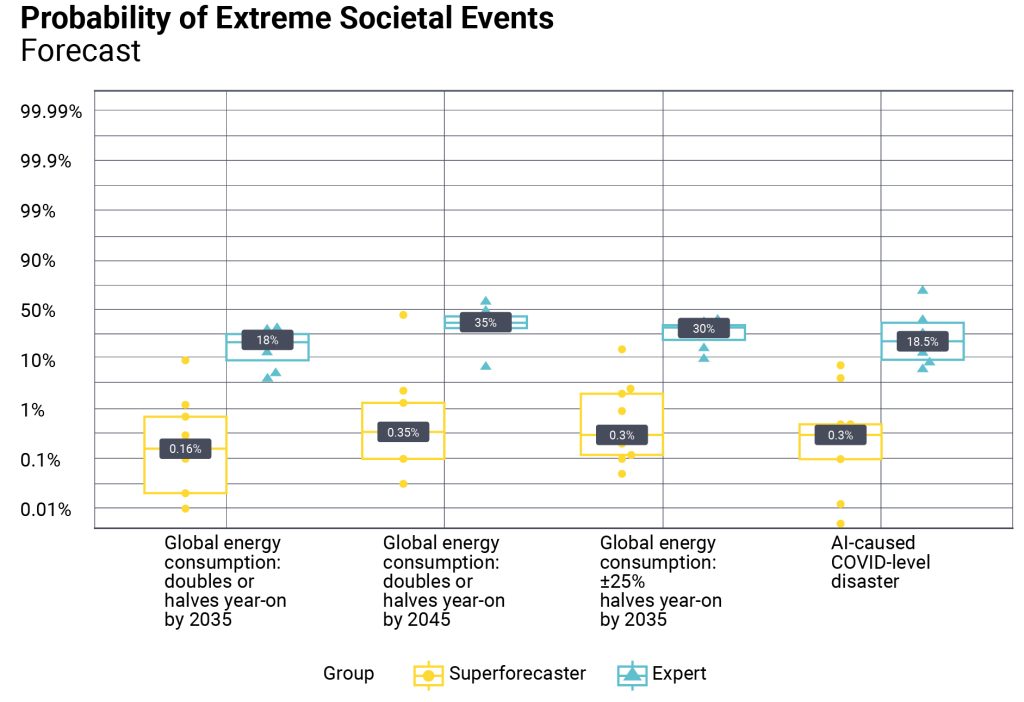

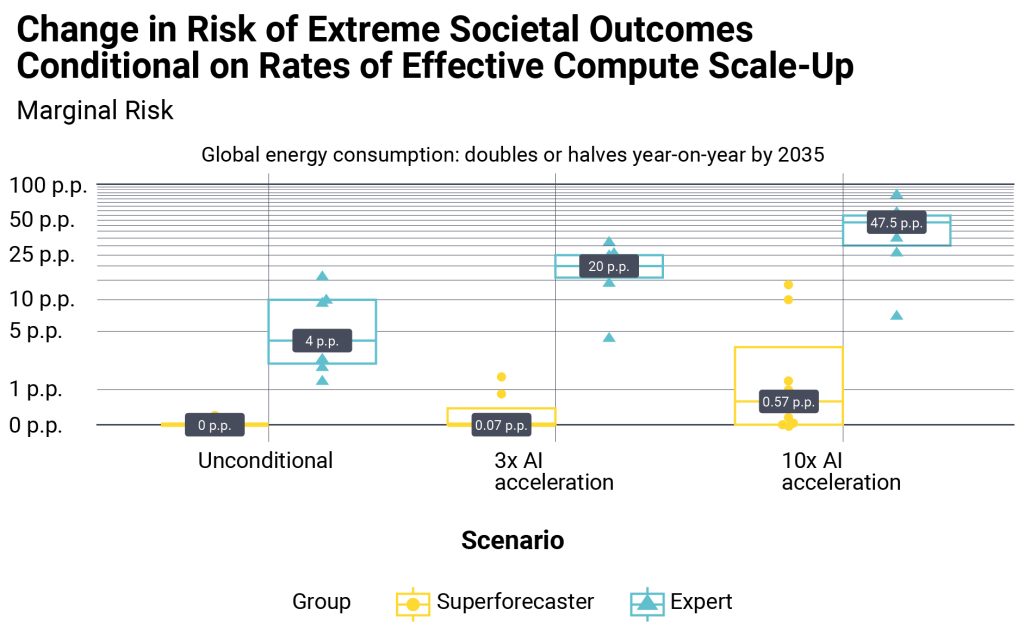

Tuttavia, è sulla seconda questione che i loro pareri si dividono nettamente. Gli esperti tendono a vedere un legame quasi diretto tra un’accelerazione dell’IA e un aumento drammatico del rischio di catastrofi. Al contrario, i super forecasters si mostrano molto più scettici. Pur riconoscendo la possibilità di un progresso tecnologico rapidissimo, non credono che ciò si tradurrebbe automaticamente in impatti sociali estremi. La loro analisi suggerisce che barriere tecniche, limiti fisici e, soprattutto, l’intervento umano fungerebbero da freno, impedendo gli esiti più nefasti.

La Frattura del Giudizio tra Esperti e Super Forecasters

Questa divergenza è enorme: per un evento come il raddoppio o il dimezzamento del consumo energetico globale entro il 2035, la probabilità mediana assegnata dagli esperti è due ordini di grandezza superiore a quella dei super forecasters (18% contro 0.16%).

Questa frattura nel giudizio non è solo una curiosità statistica, ma rappresenta il cuore del problema. Lo studio evidenzia che la vera divergenza non riguarda se l’AI diventerà più intelligente più velocemente (perché lo diventerà), ma se saremo in grado di gestirne le conseguenze. Per i super forecasters, l’accelerazione tecnologica non sembra essere il fattore cruciale per determinare un futuro catastrofico, suggerendo che il dibattito sulla sicurezza dell’AI debba forse concentrarsi meno sulla velocità del progresso e più sui meccanismi di controllo e sulle barriere del mondo reale.

Il rapporto e i risultati in esso riportati sono solo uno dei tanti importanti studi che rincorrono le possibili previsioni circa l’impatto dell’AI su molti aspetti delle nostre vite. Lo studio presenta delle carenze che potranno essere colmate in altre ricerche future, la prima delle quali è il campione molto piccolo: hanno partecipato infatti solo 8 esperti, di cui 4 con specifiche competenze in AI e Machine Learning, e 9 superforecasters. Il gruppo ristretto di persone coinvolte quindi rende i risultati maggiormente sensibili alle previsioni personali e sottostima degli eventuali scenari “a basso rischio”. Tuttavia, i risultati dello studio rappresentano degli incentivi-chiave per indagare più a fondo le valutazioni degli esperti e dei superforecaster riguardo gli impatti futuri dell’AI, e sui progressi della medesima.

L’incertezza del futuro è quindi una domanda chiave sull’argomento. Per questo progredire nella ricerca e cercare le risposte alle giuste domande è oggi più che mai un imperativo, sia per le implicazioni etiche che per quelle pratiche.